ChatGPT Gesundheit: KI als persönlicher Gesundheitsberater?

OpenAI erweitert ChatGPT um einen eigenen Gesundheitsbereich – mit höheren Sicherheitsstandards, Anbindung an Patientendaten und dem Versprechen, Menschen beim Verständnis ihrer Gesundheit zu unterstützen. Doch was bedeutet das konkret? Und wo liegen die Grenzen eines Systems, das keine Diagnosen stellen darf, aber trotzdem persönliche Gesundheitsdaten analysiert?

Künstliche Intelligenz hat längst Einzug in die Medizin gehalten – meist im Hintergrund, bei der Auswertung von Bilddaten oder in der Forschung. Mit ChatGPT Gesundheit macht OpenAI nun einen Schritt, der KI direkt in den Alltag von Patientinnen und Patienten bringt. Das Tool verspricht, medizinische Informationen verständlicher zu machen, Arztbesuche besser vorzubereiten und langfristige Gesundheitsmuster zu erkennen. Gleichzeitig betont das Unternehmen: Es handelt sich ausdrücklich nicht um ein Diagnosewerkzeug.

Für viele Menschen – darunter auch Ärztinnen und Ärzte, die bisher wenig mit solchen Systemen zu tun hatten – stellen sich grundlegende Fragen: Was kann ChatGPT Gesundheit tatsächlich leisten? Wie sicher sind die Daten? Und welche Risiken entstehen, wenn Laien medizinische Informationen ohne fachliche Einordnung interpretieren?

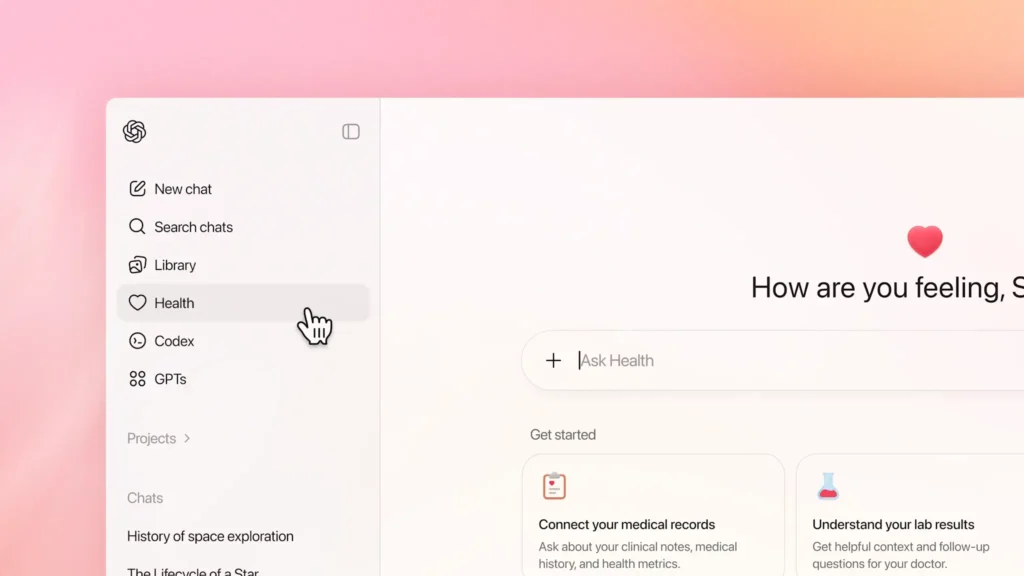

Was ist ChatGPT Health

ChatGPT Health ist kein eigenständiges Produkt, sondern ein separater, technisch abgesicherter Bereich innerhalb der ChatGPT-Plattform. Anders als in normalen Chats können hier persönliche Gesundheitsdaten hochgeladen und verarbeitet werden – etwa Laborbefunde, ärztliche Berichte oder Daten aus Wearables und Fitness-Apps wie Apple Health oder MyFitnessPal.

Der entscheidende Unterschied liegt in den Sicherheitsmaßnahmen. OpenAI hat für diesen Bereich zusätzliche Verschlüsselung implementiert, die Daten werden strikt getrennt von anderen Gesprächen behandelt und ausdrücklich nicht zum Training der KI verwendet. Nutzerinnen und Nutzer können jederzeit alle hochgeladenen Informationen und App-Verbindungen löschen. Das Unternehmen betont, dass die Entwicklung in enger Zusammenarbeit mit medizinischem Fachpersonal erfolgt ist.

Dennoch bleibt eine Tatsache bestehen: Die Daten verlassen das eigene Gerät und werden auf Servern eines US-amerikanischen Technologieunternehmens verarbeitet. Gerade für europäische Nutzerinnen und Nutzer ergeben sich daraus Fragen zum Datenschutz, die über die technischen Schutzmaßnahmen hinausgehen.

Wer kann ChatGPT Health nutzen?

Der Zugang zu ChatGPT Health ist vorerst begrenzt. OpenAI startet mit einer kleinen Gruppe früher Nutzer mit Konten für ChatGPT Free, Go, Plus und Pro. Sie können sich für eine Warteliste anmelden, um die Plattform zu nutzen. Vorläufig ausgeschlossen sind Nutzer in der EU, in der Schweiz und im Vereinigten Königreich. Dort sind die Gesundheits- und Datenschutzregeln strenger.

Hier können Sie sich für die Warteliste registrieren: https://openai.com/de-DE/index/introducing-chatgpt-health/

ChatGPT Health: Was das System kann – und was es ausdrücklich nicht darf

ChatGPT Gesundheit soll Menschen dabei helfen, ihre Gesundheitsinformationen besser zu verstehen. Das System kann Laborwerte in verständliche Sprache übersetzen, medizinische Berichte zusammenfassen und dabei helfen, Fragen für den nächsten Arzttermin vorzubereiten. Wer regelmäßig Daten aus Smartwatches oder Ernährungs-Apps sammelt, kann diese einbinden und langfristige Muster erkennen lassen – etwa bei Schlafqualität, Aktivität oder Ernährungsgewohnheiten.

Im Gegensatz zu einer allgemeinen Internetsuche oder einem herkömmlichen ChatGPT-Gespräch kann das System dabei auf die individuellen Daten der Nutzerinnen und Nutzer zurückgreifen. Statt allgemeiner Erklärungen zu Blutzuckerwerten erhält man also eine Einordnung der eigenen Werte im Kontext der persönlichen Gesundheitsgeschichte.

Was ChatGPT Gesundheit aber ausdrücklich nicht tun soll und darf: Diagnosen stellen, Therapien empfehlen oder ärztliche Entscheidungen treffen. Das Unternehmen formuliert die Rolle des Systems klar als Unterstützung beim Verständnis, nicht als medizinischen Akteur. Die Verantwortung für Diagnostik und Behandlung bleibt vollständig beim medizinischen Fachpersonal.

Zwischen Empowerment und Selbstüberschätzung

Die Idee klingt zunächst vielversprechend: Informiertere Patientinnen und Patienten, die ihre Befunde verstehen und strukturierte Fragen stellen können, könnten die Qualität medizinischer Gespräche verbessern. Ärztinnen und Ärzte müssten weniger Zeit mit grundlegenden Erklärungen verbringen und könnten sich auf komplexere Zusammenhänge konzentrieren. Die Stärkung der Gesundheitskompetenz ist ein legitimes Ziel.

Doch genau hier beginnen die Risiken. Ein KI-System, das persönliche Gesundheitsdaten analysiert und in natürlicher Sprache darüber kommuniziert, kann bei Laien leicht den Eindruck erwecken, es handle sich um eine fachliche Einschätzung. Menschen neigen dazu, Informationen aus vermeintlich intelligenten Systemen besonders zu vertrauen – auch wenn diese explizit als Hilfswerkzeug deklariert sind.

Die Gefahr liegt nicht nur in möglichen Fehldeutungen durch die KI selbst, sondern vor allem in der Interpretation durch die Nutzerinnen und Nutzer. Wer ohne medizinisches Hintergrundwissen einen Laborbefund analysiert bekommt, kann einzelne Werte überbewerten, Zusammenhänge falsch einordnen oder sich in falscher Sicherheit wiegen. Im schlimmsten Fall führt das dazu, dass ernsthafte Symptome nicht ärztlich abgeklärt werden – oder umgekehrt, dass unnötige Ängste entstehen.

Qualität hängt von den Eingaben ab

Ein weiteres Problem betrifft die Datengrundlage. ChatGPT Gesundheit kann nur so gut sein wie die Informationen, die es erhält. Unvollständige Befunde, fehlende Kontextinformationen oder Daten aus unterschiedlichen Quellen können zu irreführenden Einschätzungen führen. Anders als eine Ärztin oder ein Arzt kann das System nicht nachfragen, keine körperliche Untersuchung durchführen und keine differenzialdiagnostischen Überlegungen anstellen.

Hinzu kommt die Frage der Haftung. Wenn ein Patient oder eine Patientin auf Basis einer KI-gestützten Interpretation Entscheidungen trifft – wer trägt dann die Verantwortung? OpenAI schließt diese Last ausdrücklich aus und verweist auf die Eigenverantwortung der Nutzerinnen und Nutzer. Doch in der Praxis kann es schwierig werden, diese Grenze klar zu ziehen.

Das Problem der KI-Halluzinationen im Gesundheitskontext

Eine besondere Herausforderung bei KI-Systemen sind sogenannte Halluzinationen – Antworten, die sprachlich korrekt und überzeugend klingen, inhaltlich aber falsch, unvollständig oder unbegründet sind. Im Gesundheitsbereich kann das bedeuten: falsch erklärte Laborwerte, nicht zutreffende Ursache-Wirkungs-Zusammenhänge oder unzulässige Verallgemeinerungen wie „das ist meist harmlos“, obwohl eine ärztliche Abklärung dringend nötig wäre.

Das Risiko ist hier deutlich höher als in vielen anderen Anwendungsfeldern. Menschen nehmen Gesundheitsinformationen emotional ernst und handeln möglicherweise danach. Eine scheinbar plausible, aber medizinisch nicht abgesicherte Interpretation kann im schlimmsten Fall dazu führen, dass wichtige Symptome ignoriert oder falsche Schlüsse gezogen werden.

OpenAI hat nach eigenen Angaben mehrere Maßnahmen ergriffen, um dieses Risiko zu begrenzen. Über 260 Ärztinnen und Ärzte haben an der Entwicklung mitgewirkt und eine Antwortlogik geschaffen, die Unsicherheiten klar benennt, keine voreiligen Schlüsse zieht und bei kritischen Themen aktiv zur ärztlichen Abklärung rät. Das System ist darauf trainiert, bei Unklarheiten eher zu sagen „Ich weiß es nicht“ als zu spekulieren, mehrere mögliche Erklärungen nebeneinander darzustellen und medizinische Warnzeichen explizit zu nennen.

Zusätzlich arbeitet OpenAI mit einem speziellen Bewertungsrahmen namens HealthBench, der Antworten nicht nach dem Schema „richtig oder falsch“ bewertet, sondern nach klinischen Kriterien wie Sicherheit, Klarheit und angemessener Vorsicht. Die Einbindung realer Gesundheitsdaten soll zudem Spekulationen reduzieren, weil Interpretationen immer im individuellen Kontext erfolgen können.

Trotz dieser Maßnahmen bleibt das Grundproblem bestehen: Eine KI kann keine klinische Gesamtverantwortung übernehmen. Sie erkennt keine nonverbalen Hinweise, hat kein ärztliches Bauchgefühl und kennt nicht alle Rahmenbedingungen einer Person. Das System lernt auch nicht aus individuellen Gesundheitsgesprächen – Fehler werden nicht an andere Nutzerinnen und Nutzer „weitervererbt“, aber sie können im Einzelfall trotzdem entstehen.

Die größte Gefahr entsteht nicht durch die KI allein, sondern durch falsche Erwartungen an sie. Wenn Menschen ChatGPT Gesundheit als Arzt wahrnehmen statt als Hilfswerkzeug, wenn ärztliche Aufklärung ersetzt statt ergänzt wird oder wenn klare Grenzen nicht kommuniziert werden, kann auch ein gut konzipiertes System Schaden anrichten.

Regulatorische Unsicherheiten

Während in den USA bereits erste Gesundheits-Apps mit KI-Unterstützung verfügbar sind, ist die rechtliche Lage in Europa komplexer. Die Datenschutz-Grundverordnung stellt hohe Anforderungen an den Umgang mit Gesundheitsdaten, und die EU-Regulierung zu Medizinprodukten könnte auch für manche KI-Anwendungen relevant werden.

ChatGPT Gesundheit bewegt sich in einer Grauzone. Das Unternehmen betont, dass es sich nicht um ein Medizinprodukt handelt – doch die Abgrenzung ist nicht immer eindeutig. Gerade die Anbindung an Patientenakten und die individuelle Auswertung von Gesundheitsdaten könnten regulatorische Fragen aufwerfen, die noch nicht abschließend geklärt sind.

Ein Werkzeug mit Verantwortung

ChatGPT Gesundheit ist weder die Lösung aller Probleme im Gesundheitswesen noch eine Bedrohung für die ärztliche Versorgung. Es ist ein digitales Werkzeug, das Menschen dabei helfen kann, ihre Gesundheitsinformationen besser zu verstehen – wenn es richtig eingesetzt wird und seine Grenzen klar bleiben.

Ja, KI-Halluzinationen sind im Gesundheitsbereich eine ernstzunehmende Gefahr. Aber sie werden bei ChatGPT Gesundheit bewusst adressiert, technisch und konzeptionell begrenzt, medizinisch begleitet und klar in ihrer Verantwortung eingeordnet. Die entscheidende Schutzmaßnahme bleibt jedoch der Mensch – nicht Technik ersetzt medizinische Kompetenz, sondern gute Technik unterstützt gute Medizin.

Die entscheidende Frage ist nicht, ob solche Systeme kommen, sondern wie wir damit umgehen. Für Patientinnen und Patienten bedeutet das: kritisch bleiben, die Grenzen des Systems verstehen und im Zweifel immer medizinisches Fachpersonal konsultieren. Für Ärztinnen und Ärzte stellt sich die Herausforderung, solche Tools in die Kommunikation einzuordnen, ohne dass das Vertrauensverhältnis leidet.

Gesundheitskompetenz ist wichtig – aber sie darf nicht durch technische Scheingewissheiten ersetzt werden. ChatGPT Gesundheit kann ein nützlicher Baustein sein, wenn alle Beteiligten verstehen, dass es ein Hilfsmittel ist und kein Ersatz für menschliche Expertise, Erfahrung und Verantwortung.

AKTUELLE ARTIKEL

AKTUELLE ARTIKEL

Sie suchen einen verlässlichen IT-Partner für Ihre Arztpraxis?

Wir sind it4med, ein auf Ärzte spezialisierter IT-Dienstleister. Unsere Experten unterstützen Sie bei der Planung, Umsetzung und Wartung Ihrer IT-Infrastruktur – maßgeschneidert auf die Anforderungen Ihrer Praxis. Haben Sie Fragen oder benötigen Sie eine Beratung? Kontaktieren Sie uns – wir stehen Ihnen gerne zur Verfügung!